아이브릭스 자체 LLM, Open-Ko-LLM 리더보드 1위 달성

작은 규모의 언어모델 ‘세레브로(Cerebro)’로 한국어 AI 경쟁력 입증

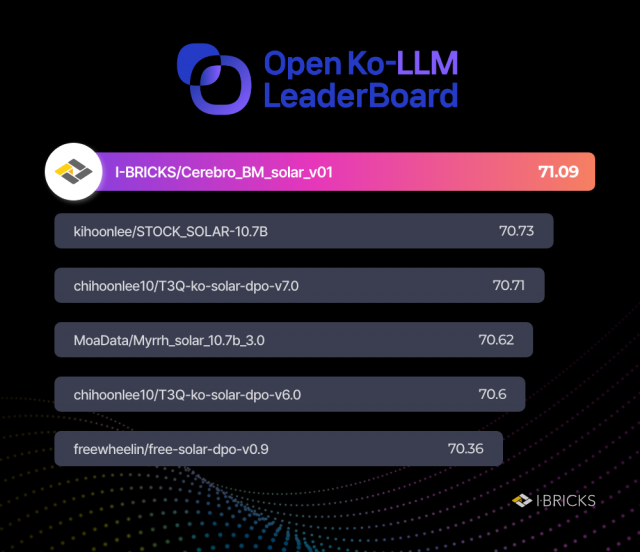

아이브릭스의 언어모델이 Open-Ko-LLM 리더보드 1위에 올랐다

성남--(뉴스와이어)--인공지능(AI) 전문기업인 아이브릭스(대표 채종현)는 허깅페이스에서 운영하는 ‘Open-Ko-LLM 리더보드’에서 자체 개발 대규모 언어모델(LLM)로 1위를 달성했다고 24일 밝혔다.

‘Open-Ko-LLM 리더보드’는 한국어 LLM 모델 성능을 평가하는 벤치마크로, △추론능력 △상식능력 △언어 이해 종합능력 △환각현상 방지능력 △한국어 상식생성능력 등 5가지 기준으로 평가해 순위를 매긴다.

현재까지 약 1713개의 언어모델이 참여하고 있고, 대기업부터 스타트업까지 치열하게 경쟁하고 있는 이 리더보드에서 아이브릭스의 언어모델 ‘Cerebro-BM-solar’가 평균 71.09점으로 1위를 차지했다. 특히 환각현상 방지능력(Ko-TruthfulQA)과 상식능력(Ko-HellaSwag) 부문의 점수는 각각 86.02점, 81.18점으로 매우 높은 평가를 받았다.

Cerebro-BM-solar는 두 개의 SOLAR 언어모델을 Merge(Gradient Slerp)하고 파인튜닝해 개발된 모델로, 매개변수 107억 개의 적은 파라미터로도 뛰어난 성능을 보여줌으로써 경제성까지 입증했다. 최근 전 세계적으로 글로벌 기업들이 매개변수가 적은 모델로 개발 방향을 바꾸고 있는 추세에서 보다 저렴한 비용으로 효율적인 AI 모델을 구축하기 위한 노력이 계속되는 가운데 Cerebro-BM-solar는 AI 사업의 트랜드가 반영된 모델이라 할 수 있다.

아이브릭스 박호진 연구소장은 “이번 1위 달성은 지난 몇 년간 자체 LLM을 개발하면서 쌓인 노하우들이 큰 도움이 됐다”며 “특히 Open-Ko-LLM 리더보드에서의 1위는 한국어 AI 경쟁력을 입증하는 계기로, 앞으로도 뛰어난 기술력을 바탕으로 한국형 LLM 모델 연구 개발에 매진해 더 혁신적인 모델을 선보이겠다”고 말했다.

아이브릭스 소개

아이브릭스는 2016년 설립된 한국어 언어처리 전문기업으로, 하이브리드형 챗봇/클라우드 환경 기반의 검색/사용자 행위 기반 실시간 맞춤형 콘텐츠 추천/Text Analytics를 활용한 비정형데이터 분석 등 다양한 사업을 진행하고 있다. 최근 소규모 거대언어모델을 개발해 생성형 AI와 관련된 사업을 활발히 진행 중에 있다.